Recentelijk verschenen er o.a. een drietal artikelen waarin ingegaan wordt op de rol die ‘machine-learning’ speelt bij dit type onderzoek. Zowel bij het bepalen van de bewoonbaarheid van exoplaneten, bij de deeltjesfysica en bij het herkennen van zogeheten zwaartekrachtlenzen speelt ‘machine-learning’ inmiddels een grote rol. De groeiende rol van deze technologie voor de astro- en deeltjesfysica blijkt o.a. uit onderstaande artikelen.

Wetenschappers gebruiken deze ‘machine-learning’ technologie voor snelle en slimme data analyse, en zeker ook in de deeltjes- en astrofysica wordt het steeds meer gebruikt. Het is in deze terecht zoals de Engelse uitdrukking luidt ‘cutting-edge technology’. In het Symmetry alsook het Astronomy online magazines verschenen het afgelopen jaar drie opmerkelijke artikelen hierover. ‘Neural Networks for Neutrino’s’ gebaseerd op de studie verschenen in Royal Astonomical Society van januari 2018, ‘Neural Networks meet Space’ gebaseerd op de studie van Yashar D. Hezaveh verscheen in Nature van augustus 2017. Het derde artikel ‘AI beats astronomers predicting survivability of ‘Tatooines’, verscheen in mei 2018 in Astronomy.com.

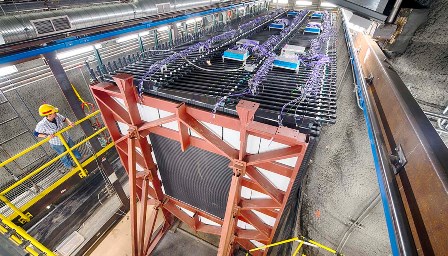

NOvA experiment credits; futurity

Machine-learning (n.1) en i.i.g. de term is ontstaan uit de queeste naar A.I. of kunstmatige intelligentie, reeds in de jaren zestig van de vorige eeuw. Er zijn meerdere toepassingen voor machine-learning, waaronder bv. ‘classificatie’ (inputs worden onderverdeeld in twee of meer klassen en de ‘leerlmachine’ moet een model maken dat ongeziene invoer toewijst aan een of meer (multi-label classificatie) van deze klassen.Dit wordt meestal op een gecontroleerde manier behandeld. Spamfiltering is een voorbeeld van classificatie, waarbij de ingangen e-mail (of andere) berichten zijn en de klassen “spam” en “geen spam” zijn.) Een methode bij machine-learning is het gebruik van zogeheten ‘neurale netwerken’ (n.2). Deze neurale netwerken zijn geïnspireerd op de architectuur van het menselijk brein, waarin een dicht netwerk van neuronen snel en efficiënt informatie kunnen analyseren. In de artificiële versie hiervan, bestaan de ‘neuronen’ uit enkele computationele eenheden die geassocieerd worden met de pixels van het te analyseren beeld. De neuronen zijn georganiseerd in lagen, tot honderden lagen diep. Iedere laag zoekt naar kenmerkende eigenschappen van het desbetreffende beeld, waarop het deze gevonden informatie vervolgens doorseint naar de volgende laag enz. dat op zijn beurt naar informatie binnen deze informatie doorzoekt. Het bijzondere aan het proces is dat de neurale netwerken zichzelf autonoom kunnen aanleren naar welke kenmerkende eigenschappen ze op zoek moeten gaan. Dit is vergelijkbaar met de manier waarop kinderen objecten leren herkennen. Je vertelt ze niet precies wat een hond is; je toont ze afbeeldingen van honden. Vervolgens pikken ze niet alleen de foto’s van honden uit de stapel maar geven ze aanvullende informatie over het gewicht, afmeting en type hond.

Neural Networks for Neutrino’s

In dit qua verschijning middelste artikel, maar hier als eerste genoemd daar hier tevens ingegaan wordt op een stukje historie naar aanleiding van de zoektocht naar neutrino’s alsook het gebruik van machine-learning om met computers deze deeltjes sneller te kunnen identificeren. Reeds in de jaren ’60 van de vorige eeuw zetten natuurkundigen zogeheten ‘bubble chambers’ in om naar de kleine deeltjes te zoeken die met het blote oog onzichtbaar waren. In deze kamers bevonden zich vaten die waren gevuld met een heldere vloeistof die net onder het kookpunt was verhit, zodat zelfs de kleinste boost in energie, bijvoorbeeld van een geladen deeltje erin, zou borrelen, een gebeurtenis die een camera zou aanzetten om een foto te maken. Aan een groep van ‘scanners’ was het de taak de deeltjes op de foto te zoeken. Opmerkelijk hierbij was dat deze groep scanners voornamelijk uit vrouwen bestond (n.3). Kennelijk letten zij op een andere manier op de details op de foto’s.

Het was de natuurkundige Paul Hough die deze taak aan machines toebedeelde en de ‘Hough Transform’ bedacht, een slim algoritme om de deeltjes te identificeren. De computerwetenschappers ontwikkelde deze ‘Hough Transform’ verder door voor toepassingen in o.a. ‘computer vision’, pogingen om computers te trainen om de complexe functie van het menselijk oog na te bootsen. Tussen deeltjesfysici en informatici was het decennia lang een heen- en weer aan kennisoverdracht. Algoritmes hielpen wetenschappelijke aberraties uit achtergrond data te halen en werden gebruikt bij fysica experimenten zowel bij de Large Electron-Positron Collider bij CERN alsook bij de Tevatron in het Fermi National Accelerator Lab. En meer recentelijk worden de algoritmes ook toegepast bij patroonherkenning in kolossale datasets bij neutrino experimenten.

Bij het NOvA experiment (NOVA is een samenwerking van 180 wetenschappers en ingenieurs van 28 instellingen die neutrino-oscillaties willen bestuderen met behulp van de bestaande NuMI-neutrino-straal bij Fermilab. Het NOVA-experiment is ontworpen om te zoeken naar oscillaties van muon-neutrino’s voor elektronenneutrino’s door de elektron-neutrino-gebeurtenisfrequentie te vergelijken die is gemeten op de Fermilab-site met de elektronneutrino-gebeurtenisfrequentie gemeten op een locatie net ten zuiden van International Falls, MN 810 kilometer van Fermilab verwijderd. Als er oscillaties optreden, ziet de verste plaats het uiterlijk van elektronen in de muon-neutrino-straal geproduceerd door Fermilab. n.4) bestuderen wetenschappers een straal neutrino’s die zijn gemaakt in het Fermilab te Chicago. De neutrino’s stromen dwars door de aarde naar een detector van 14.000 metrische ton gevuld met vloeibare scintillator, een materiaal dat fluoresceert wanneer het wordt geraakt door een geladen deeltje of een hoogenergetisch foton, gehuisvest in Minnesota vlakbij de grens met Canada. Als een neutrino botst met de scintillator geeft het een deeltje vrij. De detector verzamelt informatie over het patroon en energie van deze deeltjes. De wetenschappers gebruiken deze informatie om erachter te komen wat er in de originele neutrino activiteit (‘original neutrino event’) gebeurde. “Onze taak is bijna als de reconstructie van een plaats delict” zegt Mark Messier, onderzoeker bij de Universiteit van Indiana. “Een neutrino interageert en laat sporen na in de detector – wij komen naderhand en gebruiken wat we kunnen zien om erachter te komen wat de eigenschappen van de neutrino zijn of beter gezegd wat zijn ‘identiteit’ of de aard van de betreffende neutrino is .”

De laatste paar jaar worden deze algoritmes ook wel ‘Convolutional Neural Networks’ (n.5) genoemd, CNN’s om deze taak over te nemen. CNN’s zijn gemodelleerd naar de visuele cortex (De visuele cortex of gezichtsschors is het deel van de occipitale of achterhoofdskwab van de de hersenen dat betrokken is bij de visuele waarneming) van zoogdieren en worden wijdverbreid gebruikt in de technologische sector. Bv. om verbetering computer zich voor zelf rijdende auto’s. Deze netwerken zijn geconstrueerd uit meerdere lagen die simpel gezegd enigszins op filters lijken; ze bevatten een fijn vertakt netwerk van knopen die numerieke waardes of gewicht vertegenwoordigen, en aangepast en verfijnd worden zodra er input doorheen stroomt.

De term ‘deep’ van ‘Deep Learning’ komt van het feit dat er bij deze technologie zoveel lagen aangebracht zijn. Met deze techniek kun je de ruwe data nemen en door ze door deze filters te duwen verkrijg je praktisch zeer gedetailleerde kenmerken. Deze algoritmen kunnen bijvoorbeeld details geassocieerd met deeltjeswisselwerkingen van verschillende niveau’s van complexiteit uit de “beelden” halen, verzameld door registratie van de verschillende patronen van energie-afzettingen in de deeltjesdetectoren. “Die stapels filters leiden tot een soort van gesneden beelden en extraheren fysiek betekenisvolle stukjes informatie die we eerder zelf hadden geprobeerd te reconstrueren,” aldus Adam Aurisano, co-auteur en assistent-professor aan de Universiteit van Cincinnatti. Hoewel ze kunnen worden gebruikt om gebeurtenissen te classificeren zonder ze opnieuw te creëren, kunnen CNN’s ook worden gebruikt om deeltjesinteracties te reconstrueren met behulp van een methode die ‘semantische segmentatie’ wordt genoemd. Wanneer het bijvoorbeeld wordt toegepast op een afbeelding van een tabel, zou deze methode het object reconstrueren door elke bijbehorende pixel te labelen, legt Aurisano uit. Op dezelfde manier kunnen wetenschappers elke pixel labelen die is gekoppeld aan kenmerken van neutrino-interacties, en vervolgens algoritmen gebruiken om de gebeurtenis te reconstrueren.

“Al deze grote fysica-experimenten zijn echt vergelijkbaar op het niveau van machine-learning”, zegt Pierre Baldi, computerwetenschapper aan de Universiteit van Californië, Irvine. “Het zijn allemaal afbeeldingen die horen bij deze complexe, erg dure detectoren, en ‘deep learning’ is de beste methode om een ??signaal aan achtergrondruis te kunnen extraheren.” Hoewel de meeste informatie momenteel van computerwetenschappers naar deeltjesfysici gaat, kunnen andere wetenschappelijke velden nieuwe tools en inzichten uit deze experimentele toepassingen verkrijgen. Volgens Baldi spitst zich nu alles veeleer toe op de vraag of wetenschappers software kunnen schrijven die dwars door al de natuurkunde experimenten heenlopen en dan met een minimale inzet aan menskracht. Als dit doel zou worden bereikt, zou dit andere gebieden, zoals bv het ‘biomedical imaging’ zeer van dienst kunnen zijn ‘Het algoritme zou de data bekijken en het automatisch afstemmen of kalibreren op het desbetreffende veld. (Symmetry jan.2018)

Neural Networks meet Space

Een ander artikel over dit onderwerp was eveneens te vinden in het Symmetry magazine. Het artikel ‘Neural Networks mee Space’ verscheen in augustus 2017. Hierin hebben onderzoekers van het SLAC, het National Accelerator Laboratory en de Stanford Universiteit voor de eerste keer aangetoond dat neurale netwerken nauwkeurig de complexe vervormingen in ruimtetijd, zwaartekrachtlenzen, kunnen analyseren, zo een 10 miljoen keer sneller dan met traditionele methoden. Laurence Perreault Levasseur een co-auteur van de studie ‘Fast automated analysis of strong gravitational lensen with convolutional neural networks‘ (CNN, zie ook n.5) die gepubliceerd is in Nature op 30 augustus 2017. De onderzoeksgroep van het SLAC en Stanford is samengebracht onder het KIPAC, het Kavli Instituut for Particle Astrophysics and Cosmology, gebruikte de neurale netwerken om de beelden te analyseren van sterke zwaartekrachtlenzen. Deze zwaartekrachtlenzen vervormen het beeld van een ver gelegen sterrenstelsel tot ringen en bogen door toedoen van de zwaartekracht van een massief object, zoals een cluster van sterrenstelsels. (Def. Een zwaartekrachtlens (ook gravitatielens) is een zeer sterk zwaartekrachtveld, zoals dat van een sterrenstelsel of een zwart gat, dat het licht van een daarachterliggend voorwerp afbuigt. Dit lens-effect treedt op, wanneer waarnemer, zwaartekrachtveld (lens) en achterliggende voorwerp (bron) ongeveer op één lijn staan. ) De vervormingen geven belangrijke aanwijzingen over hoe massa wordt gedistribueerd in de ruimte en hoe die verdeling in de loop van de tijd verandert. Tot nu toe was dit een langdurig en zeer arbeidsintensief proces dat kort gezegd het vergelijken van actuele beelden van lenzen met een groot aantal computersimulaties van wiskundige lensmodellen omvatte. Voor een enkele lens nam deze methode al snel weken soms zelfs maanden in beslag. De onderzoekers gebruikten zowel gesimuleerd beeldmateriaal als echt beelden van de Hubble telescoop.

zwaartekrachtlens toont vier supernova’s credits; petapixel

Om de neurale netwerken te trainen toonde men ‘ze’ in dit experiment een half miljoen gesimuleerde beelden van zwaartekrachtlenzen op een dag. Het resultaat was dat de netwerken nieuwe lenzen met de precisie konden analyseren vergelijkbaar met traditionele methoden. “De neurale netwerken die we hebben getest – drie publiek beschikbare neurale netwerken en een die we zelf hebben ontwikkeld – waren in staat om de eigenschappen van elke lens te bepalen, inclusief de verdeling van de massa en de vergroting van het beeld van het sterrenstelsel op de achtergrond,” zegt de de hoofdauteur van het onderzoek, Yashar D. Hezaveh, een postdoctoraal onderzoeker van KIPAC betrokken bij NASA/Hubble Dit gaat veel verder dan recente toepassingen van neurale netwerken in de astrofysica, die zich beperkten tot het oplossen van classificatieproblemen, zoals het bepalen of een afbeelding een zwaartekrachtlens toont of niet. (Symmetry aug.2017)

https://www.nature.com/articles/nature23463https://arxiv.org/abs/1708.08843

AI beats astronomers in predicting survivability of Tatooines.

Zo luidde de kop van dit artikel. Het gebruikt de term AI in algemene zin en met behulp hiervan hebben astronomen nu een betere en snellere methode voor bepalen van de bewoonbaarheid van exoplaneten in een baan om meer dan één ster. In de filmserie Star Wars is Tatooine een fictieve woestijnplaneet die dienst doet als de thuiswereld Tusken Raiders en Luke Skywalker. Zijn schoonheid werd bepaald niet door dor zand maar specifiek – Tatooine is een circumbinaire planeet, een planeet die om twee sterren draait in plaats van slechts één – door zijn iconische dubbele zonsondergang.

Circumbinaire planeet OGLE-2007 credits; wikipedia

Daar deze planeten twee sterren omcirkelen i.p.v. een ervaren ze routinematig onregelmatige banen, wat er vaak toe leidt dat ze ofwel helemaal uit het systeem worden verwijderd of door een van de sterren van het systeem worden verslonden. Om de kansen te berekenen van bepaalde exoplaneten m.b.t. het lang genoeg overleven om het leven te doen evolueren, moeten astronomen een notoir lastig probleem oplossen dat bekend staat als het ’three-body’problem. “Toen we miljoenen mogelijke planeten met verschillende banen simuleerden met behulp van traditionele methoden, ontdekten we dat planeten voorspeld werden als stabiel, maar dit niet het geval bleek en viceversa,” aldus Chris Lam, hoofdauteur van de studie en recent afgestudeerd aan Columbia University. Omdat het berekenen van de stabiliteit van de baan van een planeet in de tijd een belangrijke factor is bij het bepalen van de bewoonbaarheid, is dit een groot probleem.

Om het ’three-body’ probleem bij circumbinaire planeten op te lossen, probeerde een team van astronomen een nieuwe aanpak uit te proberen – en het lijkt een geslaagde aanpak. In een recent gepubliceerd onderzoek in het tijdschrift Monthly Notices of the Royal Astronomical Society laten de onderzoekers zien dat berekeningen die worden uitgevoerd door AI – met name een diep neuraal netwerk, zie n.2 – nauwkeuriger voorspellingen kunnen doen dan mensen over de stabiliteit op langere termijn van circumbinaire planeten. “Classificatie met tal van complexe, onderling verbonden parameters is het perfecte probleem voor machine learning,” zei David Kipping, een professor aan Columbia University en supervisor van het onderzoek.

Om te testen hoe effectief kunstmatige intelligentie is om de blijvende stabiliteit van circumbinaire planeten te voorspellen, creëerden de onderzoekers 10 miljoen hypothetische circumbinary planeten met een veelheid van verschillende banen. Vervolgens werd voor elk van deze planeten een simulatie uitgevoerd om te testen of hun banen in de loop van de tijd stabiel waren. Na slechts een paar korte uren training met deze dataset, bereikte het AI-netwerk al nauwkeurigheden die groter waren dan die bereikt met standaardmethoden. Hoewel door de mens ontwikkelde algoritmen niet voorspelden wat er zou gebeuren met planeten die in de helft van de tijd regio’s van instabiliteit betraden, daalde de nauwkeurigheid van de voorspellingen van de AI nooit onder de 86 procent. Tot op heden hebben astronomen ongeveer een dozijn circumbinaire planeten bevestigd en met de recente lancering van NASA’s Transiting Exoplanet Survey Satellite (TESS) verwachten ze er nog veel meer te vinden. “Ons model helpt astronomen te weten welke regio’s het beste zijn om te zoeken naar planeten rond dubbelsterren,” zei Lam. “Dit zal hopelijk ons ??helpen nieuwe exoplaneten te ontdekken en hun eigenschappen beter te begrijpen.” Dus, tenminste voor circumbinary planet-hunters, het lijkt erop dat we eindelijk de droids hebben gevonden waarnaar we op zoek zijn. Het diepe neurale netwerk dat in deze studie wordt gebruikt, is publiek beschikbaar. (n.6)

Bronnen; Symmetry Magazine, Astronomy.com, ScienceBlogs.il.

n.1 Machine-learning is een gebied van de informatica dat gebruik maakt van statistische technieken om computersystemen de mogelijkheid te geven om “te leren” (bv. de prestaties geleidelijk aan te verbeteren voor een specifieke taak) met gegevens, zonder expliciet te worden geprogrammeerd. Tom M. Mitchell gaf een veel geciteerde, meer formele definitie van de algoritmen die in het machine-leergebied werden bestudeerd: “Een computerprogramma zou leren van ervaring E met betrekking tot een aantal klasse van taken T en prestatiemaatstaf P als zijn prestaties bij taken in T, zoals gemeten met P, verbetert met ervaring E. Deze definitie van de taken waarbij machine learning betreft, biedt een fundamenteel operationele definitie in plaats van het definiëren van het veld in cognitieve termen. Dit volgt het voorstel van Alan Turing in zijn paper “Computing Machinery and Intelligence”, waarin de vraag “Kunnen machines denken?” wordt vervangen door de vraag “Kunnen machines doen wat wij (als denkentiteiten) kunnen doen?”.

n.2 Een artificieel neurale netwerk (ANN), gewoonlijk “neuraal netwerk” (NN) genoemd, is een lerend algoritme dat geïnspireerd is door biologische neurale netwerken. Computaties zijn gestructureerd in termen van een onderling verbonden groep van kunstmatige neuronen, waarbij informatie wordt verwerkt met behulp van een connectionistische benadering van berekening. Ze worden meestal gebruikt om complexe relaties tussen inputs en outputs te modelleren, om patronen in data te vinden, of om de statistische structuur te vangen in een onbekende gezamenlijke kansverdeling tussen waargenomen variabelen.

n.3 http://scienceblogs.com/weizmann/2014/09/02/the-women-who-made-the-science-possible/

n.4 https://www-nova.fnal.gov/nova_experiment_print.html

n.5 In machine-learning is een convolutioneel neuraal netwerk (CNN of ConvNet) een klasse van diepe, feed-forward kunstmatige neurale netwerken die met succes zijn toegepast op het analyseren van visuele beelden. CNN’s gebruiken een variatie van meerlagige perceptrons ( een computermodel of computergestuurd apparaat dat is ontworpen om het vermogen van de hersenen om te herkennen en te onderscheiden te representeren of te simuleren ) die ontworpen zijn om een ??minimale voorbewerking te vereisen. Ze staan ??ook bekend als shift-invariante of ruimte-invariante kunstmatige neurale netwerken (SIANN), gebaseerd op hun gedeelde -gewichtarchitectuur en translatie-invariantie-eigenschappen. Convolutionele netwerken werden geïnspireerd door biologische processen doordat het verbindingspatroon tussen neuronen lijkt op de organisatie van de visuele cortex van het dier. Individuele corticale neuronen reageren alleen op prikkels in een beperkt gebied van het gezichtsveld dat bekend staat als het receptieve veld. De receptieve velden van verschillende neuronen overlappen elkaar gedeeltelijk zodanig dat ze het gehele gezichtsveld beslaan.

n.6 https://github.com/CoolWorlds/orbital-stability.

naschrift;

In de Ingenieur van mei 2018 staat een artikel over de opening van het Center for Artificial Intelligence (ICAI) genoemd te Amsterdam Science Park, Nederland en EU zetten in op AI alsook het artikel over Deep Learning waarin ingegaan wordt op Geometric Intelligence van Gary Marcus en, ook al is dit inmiddels verkocht aan Uber, de beperkingen die Deep Learning vooralsnog oplegt. Het artikel heet ‘Deep Learning maakt van computers nog geen mensen.’

Speak Your Mind